赌钱赚钱官方登录那就阐发它是真视频?这不是的-能赚钱的赌博软件(中国官网)科技有限公司

赌钱赚钱官方登录

赌钱赚钱官方登录

最近在韩国发生的「N 号房 2.0」事件,再次把 Deepfake(深度伪造)这个须生常谭的话题带到了台前。

加害东说念主们蚁合在 Telegram,用 AI 将女性相片合成为裸照,明示着,Deepfake 的包围圈,早已从文娱明星、政事东说念主物,延伸到你我这么的平方东说念主。

在这个 AI 成为显学的期间,咱们念念要了解,看似并不崭新的、但频年越发普及的本领,怎样影响了日常生涯。

Deepfake 进化到什么进程了,会酿成什么危害?怎样用本领反 Deepfake?平方东说念主怎样注重 Deepfake?

咱们和瑞莱贤人算法科学家陈鹏博士聊了聊这些问题。瑞莱贤人开发于 2018 年,由清华大学东说念主工智能相关院孵化,深耕 AI 鉴伪多年。

陈鹏告诉咱们,平方东说念主在辩认 Deepfake 上如故一败涂地,反 Deepfake 还得看 AI。

一张图,几秒钟,Deepfake 越来越任意

Deepfake 最早兴起于 2017 年的「好意思版贴吧」Reddit,主要步地是将明星的脸替换到色情视频的主角身上,或者恶搞政界东说念主物。

如今,贬低、搞黄色,仍然是 Deepfake 的主流用途,仅仅变得愈加容易。

陈鹏解释,汇聚一张相片也充足换脸,诚然,汇聚的数据越多,痣、五官等东说念主脸的细节也会被更好地建模,换脸的后果就越传神。

本年 4 月,两位德国艺术家的行径艺术格式,等于一个活生生的例子。

他们假想了一个 AI 相机 NUCA,相机实践 3D 打印,内置 37 毫米广角镜头,拍下的相片会被传输到云霄,由 AI「脱去一稔」,10 秒钟不到即可「出片」。

NUCA 其实不知说念你的赤身是什么样,仅仅通过分析你的性别、面部、年岁、体型等,呈现 AI 眼里你的赤身。

苟简吗?有时不伏击,几秒之间,你如故在 AI 眼前庐山真面,别东说念主说不定也会确信这是你。

韩国「N 号房 2.0」也被曝光出访佛的细节:一个 22.7 万东说念主的 Telegram 聊天室,内置一个将女性相片合成为裸照、并能退换胸部的机器东说念主,5 到 7 秒生成 Deepfake 内容。

▲聊天室截图,阐发 Deepfake 的使用方法

换脸、脱衣,仅仅 Deepfake 的一种应用。

通过生成式 AI 模子(GAN、VAE、扩散模子等),合成或伪造传神的内容,包括笔墨、图像、音频、视频,齐不错称为 Deepfake。

其中,音频的 Deepfake 也极端常见。

2023 岁首,科技记者 Joseph Cox 拨打银行的自动处事热线,播放我方用 ElevenLabs 克隆的 AI 语音「我的声息等于我的密码」,条目查验余额,没念念到语音考据得胜了。

陈鹏默示这不奇怪,之前捕捉咱们的声纹信息,需要几分钟、几十分钟的语音,但当今可能半分钟、几十秒,就能捕捉个概况。多接几个散乱词语电话,咱们的声息有时就泄漏了。

诚然,念念要更精确地克隆,复制曲调等言语作风,比如让郭德纲说英文相声、让霉霉讲汉文,仍然需要更多的语料。

甚而,文本亦然一个被 Deepfake 的范围。AI 生成的文本早已到处可见,被学生拿来舞弊和搪塞功课让憨厚头疼,但咱们有时还莫答允志到这背后的风险。

诞妄讯息和鬼话,是笔墨 Deepfake 的重灾地,陈鹏说,当年还需要东说念主类我方写案牍,但当今针对某个事件,AI 不错生成各式言论,然后自动化地投放到酬酢媒体。

Deepfake 更快速、更任意,在陈鹏看来,主要有三个原因。

一是,文生图、文生视频等生成式 AI 本领有了打破,二是,算力越发普及,消耗级的显卡如故能够运行生成式 AI 模子。

还有很伏击的少量,Deepfake 这项本领,被优化成了各式门槛更低的器具。

拿换脸例如,Deepfake 的开源格式不少,比如 Github 的 DeepFaceLive 和 Deep-Live-Cam,用户不错从网站下载代码,在土产货建立运行环境。

▲AI 马斯克直播,用的是 Deep-Live-Cam

若是不懂本领的小白照旧认为有难度,也有专科东说念主士平直把饭喂到嘴边,对模子进行封装,编写成任意好用的软件供玩家免费下载,我方赚点告蹧跶,包括好多一键脱衣的 app。

至于音频的 Deepfake,也如故有熟谙的买卖公司,以 SDK(开发器具包)或者 API(应用编程接口)的方式,让用户松开使用处事。

用户甚而不需要一台带有显卡的诱骗部署行径,而是将音频等内容上传到网站,恭候生成落拓,然后下载。

是以,复杂的本领旨趣袒护幕后,在用户眼前的是一个个「开箱即用」的界面,连青少年们也能唾手制造诞妄信息。

说七说八,陈鹏的论断是:

Deepfake 如故到了平方东说念主唾手可取的地步了。

肉眼辩认 Deepfake,东说念主类可能如故一败涂地

当一项本领「飞入寻常匹夫家」,最可能被涉及的,恰巧亦然平方东说念主。

乱来是 Deepfake 最常见的坐法方式之一。

本年岁首,一家跨国公司香港分公司因为 AI 被骗走了 2500 万好意思元。受害东说念主参加了一次视频会议,其他东说念主齐是流程「AI 换脸」和「AI 换声」的乱来分子。

▲警方示范怎样用 Deepfake 伪造多东说念主视频会议

事已至此,咱们不错作念些什么保护我方?

若是别东说念主拿 Deepfake 来骗你,钻 AI 的空子,是其中一种见识,但有保质期。

举个例子,咱们在视频通话时,若是怀疑对方是 AI 换脸,不错辅导对方作念些特定的动作,比如把手放在眼前快速划动几下、大幅度地动掸头部。

若是 AI 换脸背后的模子莫得敌手部装潢作念专门的优化,那么就会袒露,脸可能会出当今手的背部,或者一霎发生误解。

动掸头部的旨趣亦然相似,若是在网罗数据的阶段,对方莫得有益汇聚大于 45 度的追想素材,那么脸部贴合的形迹就会不当然。

但异日,这种肉眼可见的时弊,详情会缓缓减少。

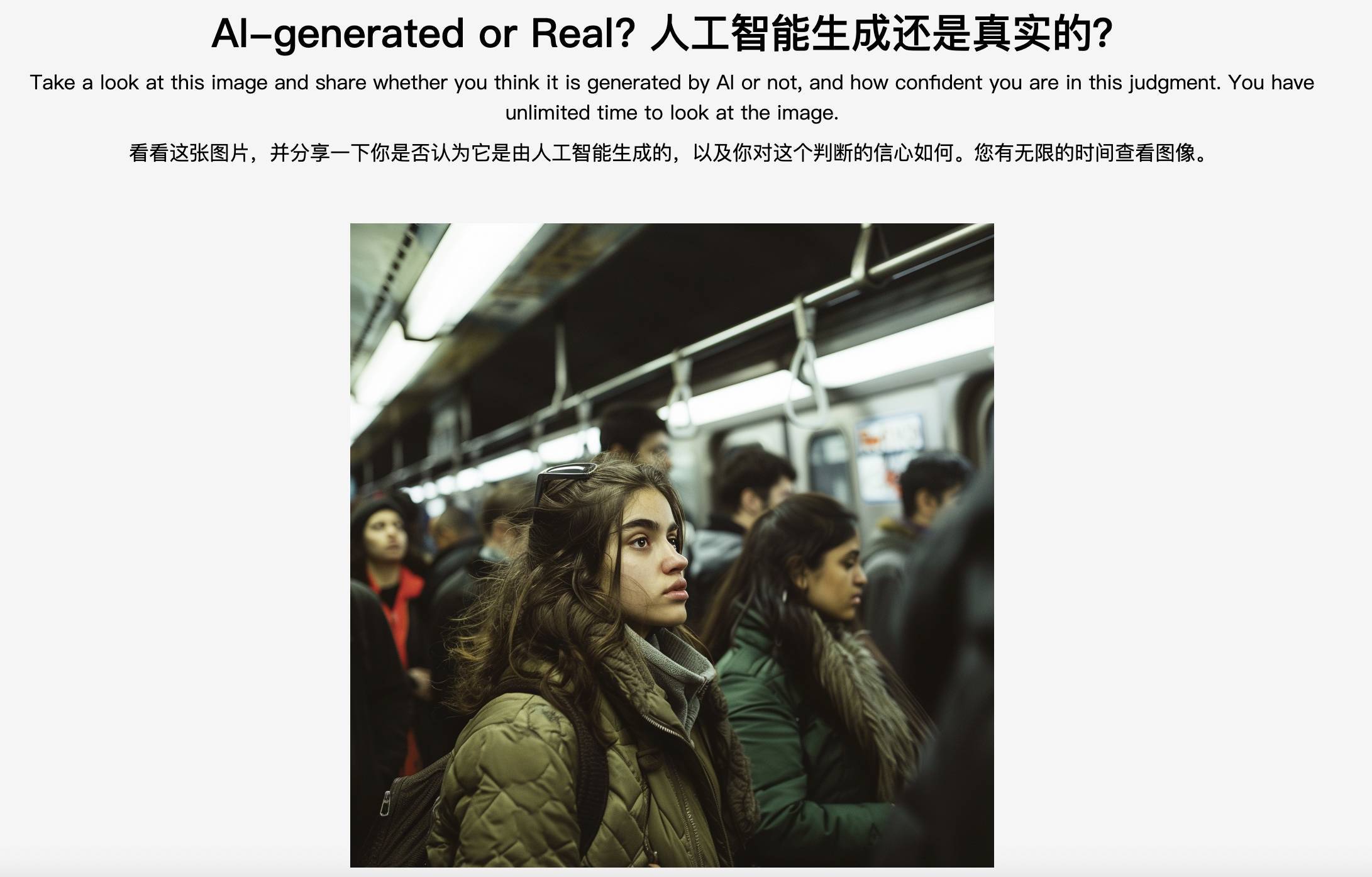

▲好意思国西北大学的「找茬」测试:AI-generated or Real?

陈鹏开打趣说,若是乱来分子认为你是只待宰的肥羊,存了心要骗你,扒光你的酬酢媒体信息,花好几天优化你的模子,那么这些方法也不保证有用。

一个视频若是莫得出现这些时弊的话,那就阐发它是真视频?这不是的。

至于说灵验没效,那详情不可透顶灵验、百分百灵验,等于一定进程上灵验。

换成专科一些的说法,东说念主类的视觉感知,在语义档次上进展得很好,比如能够松开隔离出物体或场景的含义,但在处理像素级别的、低档次的渺小离别时,感知才略不如 AI 模子。

从这个角度看,陈鹏认为,平方东说念主在隔离 Deepfake 上如故一败涂地,大师有时还有一战之力,因为看得太多,分析才略比较全面,不错看出某个处所不恰当规矩。

咱们齐不是列灯谜克,也莫得明察秋毫,但东说念主性亘古不变。是以,咱们也不错拉起传统的、和本领无关的心情防地——小心驶得万年船。

乱往往来不谋而合:窃取隐秘,愚弄怯生生、贪欲、情怀价值编故事,冒充熟东说念主或包装我方取得信任,图穷匕见以钱为最终策画。

▲瑞莱贤人旗下居品 RealBelieve,会在视频通话时发出预警

记起这点,然后进步戒心,不点生分连合,不庸俗给考据码,尽量不在互联网过度露出东说念主脸、声息、指纹等个东说念主生物信息,接到可疑电话,谈到钱就多个心眼,多种方式考据对方身份,比如究诘只须相互知说念的事情。

古语有云,攻心为上,咱们一朝意志到我方有可能被骗,那么就有可能不被骗。

魔法对轰魔法,AI 击败 AI

进步防诈意志还不够,韩国「N 号房 2.0」事件,展现了 Deepfake 的另一种坐法步地。东说念主在家中坐,锅从天上来。

诞妄裸照的受害者,可能遇上「复仇色情」——加害者以传播 Deepfake 材料为恫吓,敲诈和散乱词语受害东说念主,酿成更严重的二次伤害。

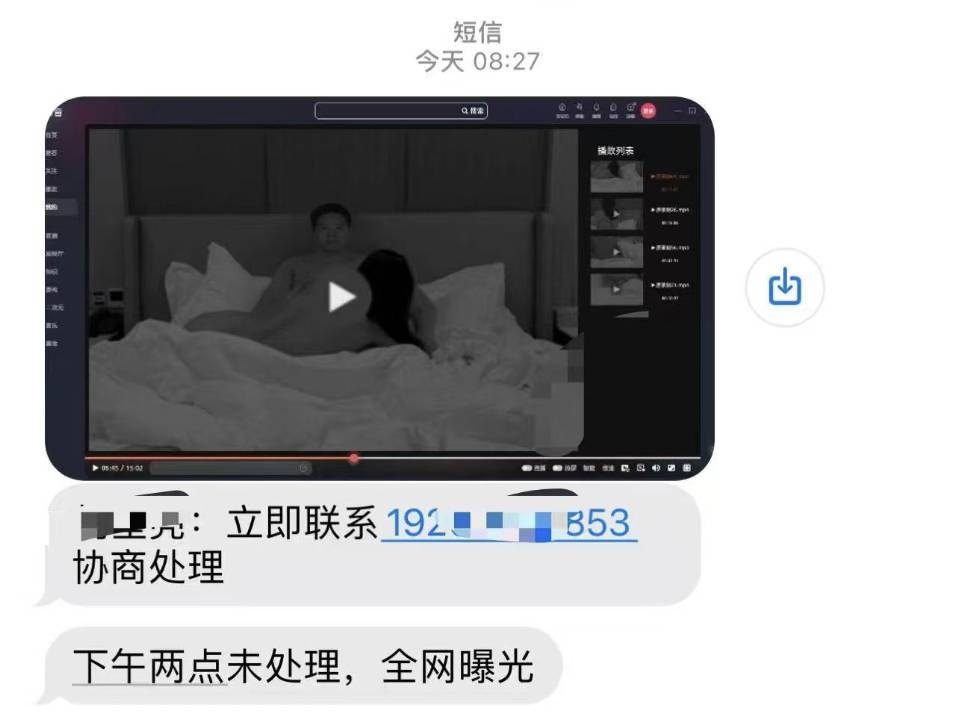

但这把镰刀也可能举到咱们头上:念念象一下,乱来团伙不知说念从那里拿到你的相片,合成到低俗视频,发短信恫吓你,不转账,就全网曝光,你该怎样自证?

陈鹏所在的瑞莱贤人,照实遭逢过这类个东说念主业务,对方说被视频换脸,能不可还他个结拜。

方法诚然是有的:魔法对轰魔法,AI 击败 AI。

陈鹏先容,AI 鉴伪主要有两条本默契线:主动式守护,被迫式检测。

先说主动式守护,当咱们在酬酢媒体发了相片,不但愿相片被别东说念主愚弄,那么不错在其中镶嵌一些视觉上不可感知的噪声。

若是别东说念主拿咱们的相片试验模子,因为这种隐形的干涉,AI 没法很好地索求其中的视觉表征,最终出来的落拓可能误解或者变糊,这叫作「扞拒样本转折」。

「半脆弱性水印」,是另一种主动式守护的方式。添加水印之后,若是别东说念主剪辑了咱们的相片,这个水印会被芜乱,咱们就不错知说念,这个图片被处理过了,不太真的。

水印不可平直贵重图片被 Deepfake,但不错检测和认证图片的信得过性。

▲国外也有访佛探索,Adobe 发起 C2PA 表率,愚弄元数据参数,当作图片出处的判定方式

诚然,主动式守护的门槛较高,咱们需要守护于未然,提前对图片进行一些处理。

更常见的情况是,咱们没法神机妙算,收到我方的「裸照」,却亦然第一次和我方这么「坦诚再见」。这时辰,就要用上被迫式检测。

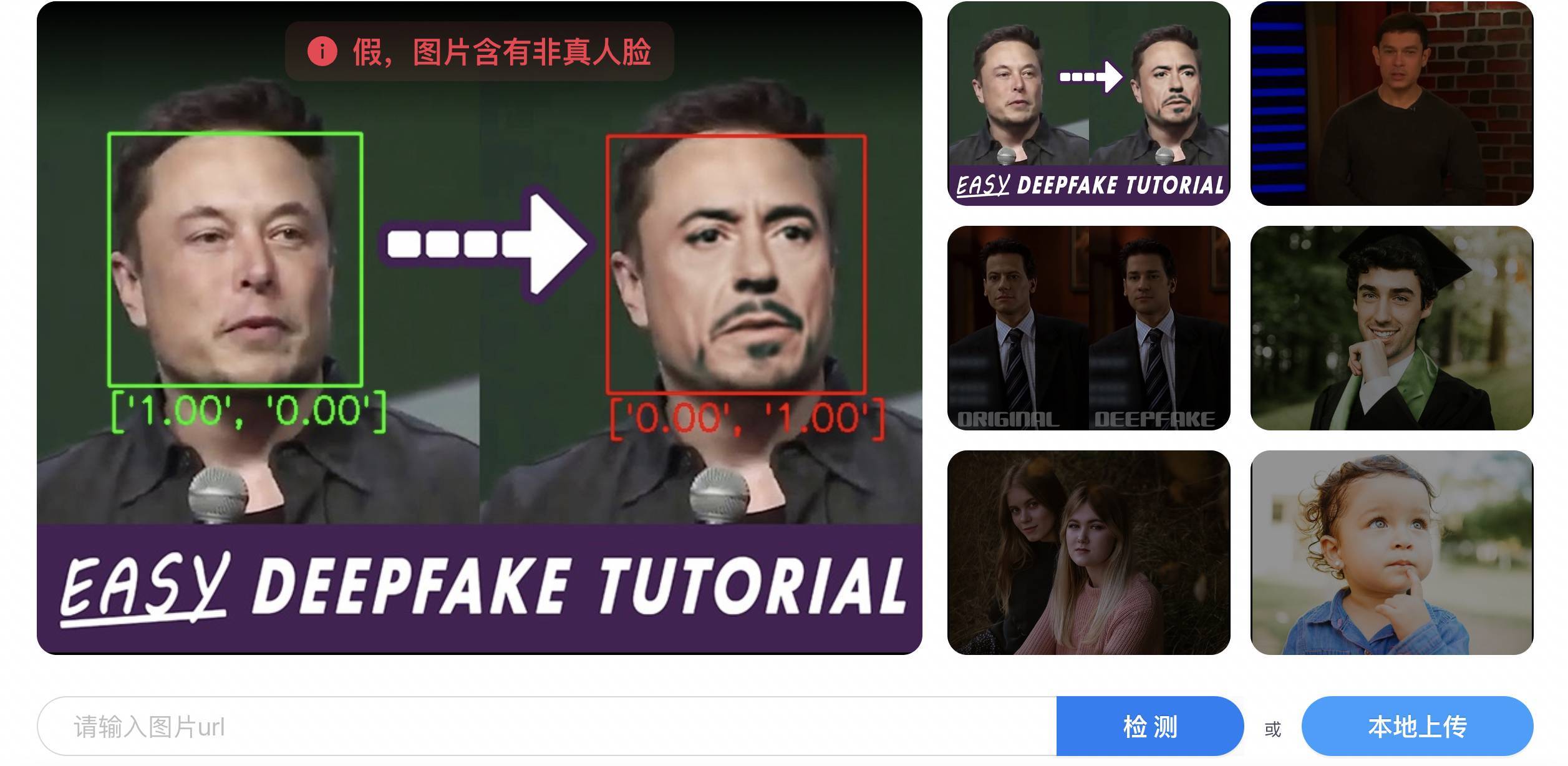

瑞莱贤人旗下有一系列精采鉴伪的 AI 居品,包括生成式 AI 内容检测平台 DeepReal、东说念主脸 AI 安全防火墙 RealGuard 等等。

▲DeapReal

任意来说,用 AI 辩认 AI,分为两个行径,先索求庞大的伪造特征,再基于这些样本建模,让 AI 学习鉴伪的规矩。

神采的误解、纹理的不对理、心机的不当然、音画的不同步、虹膜体式的不规矩、两个瞳孔高光的不一致,齐是 AI 的学习素材。

其中,视频的鉴伪,可能比图像的准确率更高,因为视频由一系列一语气的图像构成,比拟单独的图像,提供了更多不错用于鉴伪的信息,比如东说念主物在不同帧之间的动作一语气性。

本质上,AI 鉴伪有些像东说念主类用肉眼找茬,亦然在愚弄 AI 模子自己的时弊。

▲ 中科院相关东说念主员向天下开源了检测 Deepfake 的 AI 模子

但时弊详情会逐渐改善,是以产生了一个很关节的问题:是先有伪造,后有鉴伪吗?若是如斯,鉴伪不是永恒过时伪造半拍吗?

陈鹏回复,生成的本领,可能稍稍向上鉴伪的本领,但他们里面有红蓝扞拒的攻防实验室,一边模拟 Deepfake,一边守护 Deepfake,赓续进步 Deepfake 的检测才略。

若是有什么新的 Deepfake 本领面世,他们不错很快复现,然后在检测居品上进行考据,「新的本领出来,即使我莫得见过,我照旧能够一定进程上检测出来」。

何况,模子自己也有一定的泛化才略,见过的 Deepfake 内容多了,碰上没见过的,一定进程上也不错准确识别和检测。

▲ B 站等平台会对 AI 换脸文娱内容进行标注

总之,AI 伪造和鉴伪,是一个历久扞拒、相互博弈的「猫鼠游戏」。

这亦然为什么,陈鹏一直在相关 AI 鉴伪算法:

反 Deepfake 扞拒性太强了,需要历久插手,不像好多 AI 居品,作念完就无须管了。

尽管如斯,他仍然比较乐不雅:「用法律律例监管,平台进行内容惩办,产业界提供本领和器具,媒体让更多东说念主意志到风险,多方面惩办到一定进程,详情会有平缓。」

以后上网,咱们可能会堕入这么一个有些异常的场景:考据码让你讲明「我是东说念主」,Deepfake 又让你讲明「我不是我」。

本领没法透顶检测出悉数的坏心,但东说念主类也不必过于焦躁,Deepfake 的得逞仅仅终末的落拓,注重 Deepfake 却不错随时运转。

就像陈鹏所说,即使一个相等任意的 AI 居品,亦然一个很系统性的工程。

咱们是更大的系统里的部分赌钱赚钱官方登录,让受伤的东说念主发声,让加害的东说念主被罚,让贵重恶行的本领介入,让社会的不雅念举高一寸,咱们才略共同走向一个本领不被怯生生而是被合理使用的异日。